IA générative : comprendre avant d’exploiter

Chaque semaine, l’intelligence artificielle générative est présentée comme révolution absolue, menace existentielle ou solution miracle. Entre promesses démesurées et peurs irrationnelles, il devient difficile de distinguer la réalité technique des discours sensationnalistes. Cet article propose une mise au point claire : comprendre ce qu’est réellement un modèle de langage, comment il fonctionne, ses limites structurelles et les bonnes pratiques pour l’utiliser intelligemment en entreprise.

Une mise au point indispensable

L’intelligence artificielle générative occupe aujourd’hui une place centrale dans les discours économiques et médiatiques. On lui attribue des pouvoirs spectaculaires, parfois démesurés, et dans le même temps on l’accuse de menaces systémiques. Entre fascination et inquiétude, l’analyse technique disparaît souvent au profit de l’émotion. Pour un dirigeant, cette confusion est problématique. Avant d’investir, d’automatiser ou de transformer des processus, il est indispensable de comprendre ce que sont réellement les modèles de langage et comment ils fonctionnent.

Les systèmes développés par des acteurs comme OpenAI, Google ou Mistral AI reposent sur une architecture commune : le modèle de langage de grande taille, ou LLM. Ces modèles ont été entraînés sur des volumes massifs de textes afin d’apprendre les structures du langage et les corrélations statistiques entre les mots. Ils ne stockent pas des réponses prêtes à l’emploi ; ils apprennent à prédire la suite la plus probable d’une séquence donnée.

« L’algorithme propose ; l’humain structure, décide et assume. »

Un fonctionnement probabiliste, pas encyclopédique

Un LLM fonctionne sur un principe fondamental : la probabilité. Lorsqu’on lui fournit le début d’une phrase, il calcule quel mot a le plus de chances de suivre. Si l’on écrit « Le soleil se lève à l’… », le mot « est » apparaîtra avec une probabilité extrêmement élevée. Ce résultat ne provient pas d’une compréhension astronomique du phénomène, mais de l’observation statistique que cette suite de mots est très fréquente dans les textes d’entraînement.

Source : moebio.com/mind/

Ce mécanisme s’applique également à des demandes plus complexes. Si un dirigeant demande une analyse stratégique du marché du golf en Espagne, le modèle mobilisera des corrélations apprises entre tourisme, saisonnalité, pouvoir d’achat, infrastructures sportives ou climat. Il produira un texte structuré, cohérent et souvent pertinent. Cependant, il ne vérifiera pas les chiffres en temps réel et ne distinguera pas nécessairement une donnée exacte d’une approximation plausible. C’est la raison pour laquelle une réponse convaincante peut parfois contenir une information erronée. Le modèle cherche la cohérence statistique, non la vérité factuelle.

Les limites structurelles des modèles

Comprendre ces limites est essentiel pour éviter les erreurs d’usage. Un modèle de langage n’est pas un moteur de recherche et encore moins un expert responsable. Si l’on demande le chiffre d’affaires précis d’une entreprise non cotée, il pourra générer un montant crédible mais inexact, simplement parce que ce montant semble statistiquement cohérent avec le contexte. Ce phénomène, souvent qualifié d’hallucination, n’est pas une défaillance morale de la machine ; c’est la conséquence logique de son fonctionnement probabiliste.

De la même manière, un LLM ne connaît pas vos données internes sauf si vous les lui fournissez. Il ne possède pas d’intention ni de jugement. Il ne prend aucune responsabilité. La décision finale, l’interprétation stratégique et la validation des informations restent strictement humaines.

Là où la valeur devient tangible

Si l’IA générative ne doit pas être perçue comme un oracle, elle constitue en revanche un accélérateur cognitif remarquable. Dans un service marketing, par exemple, un responsable peut fournir quelques éléments structurants sur une nouvelle offre, sa cible, son positionnement et son budget. En quelques secondes, le modèle propose une structuration argumentaire, identifie des objections possibles et suggère des axes de différenciation. Ce travail, qui prenait auparavant plusieurs heures de réflexion initiale, devient un point de départ instantané.

Dans le domaine de l’analyse concurrentielle, l’outil peut synthétiser des tendances sectorielles, comparer des approches stratégiques ou proposer des hypothèses d’évolution. Il ne remplace pas l’enquête terrain, mais il permet d’accélérer la formulation d’angles d’analyse. De même, lors de la rédaction d’un compte rendu de réunion dense, il peut extraire les décisions clés, structurer les priorités et clarifier les responsabilités, améliorant immédiatement la lisibilité opérationnelle.

La valeur ne réside donc pas dans la perfection de la réponse, mais dans la vitesse de structuration et la capacité à clarifier la pensée.

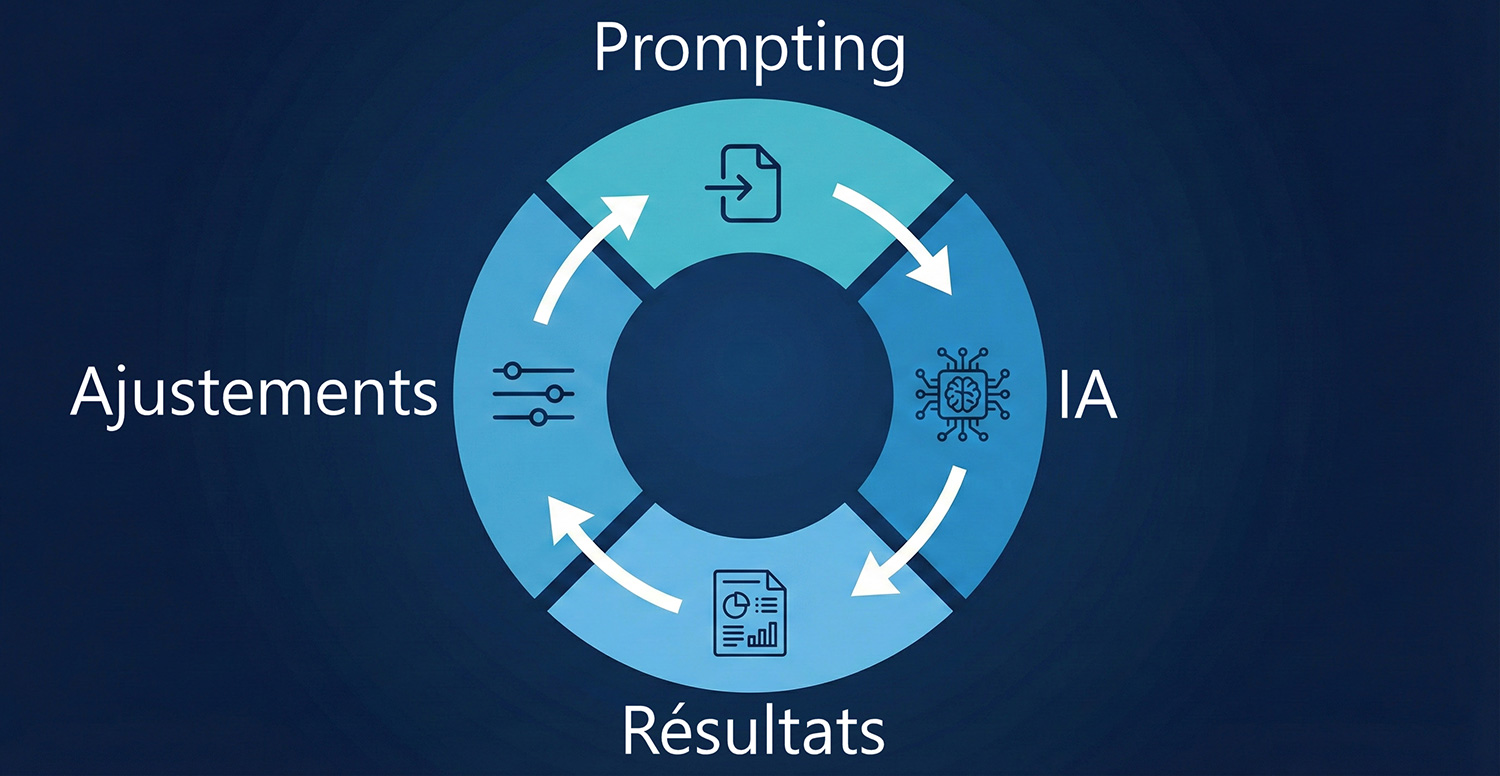

L’itération comme compétence stratégique

La qualité des résultats dépend directement de la précision des instructions. Une demande vague produit une réponse vague. Si l’on sollicite « une stratégie marketing », le modèle répondra de manière générique. En revanche, si l’on précise le marché cible, le budget disponible, les objectifs quantifiés et l’horizon temporel, la réponse gagne immédiatement en pertinence. L’usage professionnel de l’IA repose ainsi sur l’itération. On affine, on reformule, on ajuste le cadre. Cette interaction progressive transforme l’outil en véritable copilote intellectuel.

Maîtriser l’IA générative consiste moins à obtenir une réponse immédiate qu’à conduire un dialogue structuré avec le modèle. C’est une discipline intellectuelle qui s’apprend et se formalise.

La supervision comme principe non négociable

L’accélération ne doit jamais être confondue avec l’autonomie. Dans un service financier, par exemple, un modèle peut proposer une projection budgétaire ou structurer un tableau prévisionnel. Cependant, il ignore les spécificités contractuelles, les clauses bancaires ou les subtilités fiscales propres à une organisation donnée. La validation humaine demeure indispensable. La règle est simple : l’IA assiste, l’humain décide.

Cette combinaison entre vitesse algorithmique et discernement humain constitue le véritable avantage compétitif. Lorsque la supervision est intégrée au processus, l’outil devient un levier stratégique plutôt qu’un risque.

Intégrer plutôt qu’expérimenter

La transformation durable ne provient pas d’expérimentations isolées, mais de l’intégration méthodique dans les processus métiers. Partout où l’information circule et doit être structurée, synthétisée ou reformulée, l’IA peut apporter un gain de temps significatif. En marketing, elle accélère la production et l’optimisation de contenus. En relation client, elle aide à formuler des réponses plus claires et cohérentes. En ressources humaines, elle structure des offres d’emploi ou des synthèses d’entretien. En finance, elle facilite la simulation de scénarios. En production, elle formalise des procédures.

L’enjeu n’est pas technologique, il est organisationnel. Il s’agit de définir des règles d’usage, des points de contrôle et une gouvernance claire.

Comprendre pour maîtriser

L’intelligence artificielle générative n’est ni une entité autonome ni une solution universelle. Elle est un système probabiliste extrêmement performant pour produire du langage structuré à grande vitesse. Les organisations qui en tireront un avantage durable seront celles qui auront compris ses mécanismes, formalisé ses usages et maintenu la responsabilité humaine au cœur des décisions.

Dans cette perspective, la technologie ne remplace pas le jugement ; elle l’amplifie. Et c’est précisément dans cet équilibre que réside la véritable transformation stratégique.

Retrouvez notre podcast sur Spotify :

Pour en savoir plus

- Vaswani et al., Attention Is All You Need (2017), article fondateur de l’architecture Transformer, base des LLM modernes.

- Jurafsky & Martin, Speech and Language Processing, manuel académique de référence sur les modèles probabilistes en traitement automatique du langage.

- Stanford University, CS224N : cours avancé sur le NLP et les modèles de langage.

- MIT, Introduction to Deep Learning (6.S191).

- MILA, Publications en apprentissage profond et IA probabiliste.

- OpenAI, Papers techniques sur le RLHF et l’alignement des modèles.

- Google DeepMind, Recherches sur la factualité et les limites des LLM.

- Anthropic, Travaux sur la Constitutional AI et la sécurité des modèles.

- Stanford University, HELM Benchmark : cadre d’évaluation globale des modèles de langage.

- EleutherAI, ressources open source sur l’entraînement et l’évaluation des LLM.

- INRIA, publications françaises sur robustesse, explicabilité et fiabilité des systèmes d’IA.

- OECD, rapports sur l’impact économique et social de l’IA.

- World Economic Forum, Future of Jobs Report, transformation des compétences.

- NeurIPS et ICML, conférences scientifiques majeures en intelligence artificielle et apprentissage automatique.

- Nature Machine Intelligence, revue scientifique internationale dédiée aux avancées en IA.

Sommaire

- Une mise au point indispensable

- Un fonctionnement probabiliste, pas encyclopédique

- Les limites structurelles des modèles

- Là où la valeur devient tangible

- L’itération comme compétence stratégique

- La supervision comme principe non négociable

- Intégrer plutôt qu’expérimenter

- Comprendre pour maîtriser

- Pour en savoir plus

Derniers articles

Newsletter

Recevez les derniers articles directement par mail